RESUMO: Um exemplo simples com bolas numeradas ajuda a entender por que usamos "n - 1" na variância e como surge o erro padrão da média. Inclui gráficos para facilitar a visualização.

Para explicar o erro padrão da média e apresentar a

lógica dos graus de liberdade associados à variância da amostra, vamos usar um exemplo irreal — mas útil para

compreender esses conceitos.

Imagine uma urna contendo três bolas numeradas: 4,

10 e 16. Um jogador retira uma bola, anota o número, retorna a bola à urna e

faz uma nova retirada. Novamente, anota o número e retorna a bola. Em seguida,

calcula a média dos dois números obtidos, que será sua pontuação no jogo.

Do ponto de vista teórico, temos uma população

infinita de bolas numeradas (já que a bola é devolvida à urna após cada

retirada), e esse jogo pode ser repetido indefinidamente. A média populacional μ

da variável em estudo é:

Como pode assumir os valores 4, 10 ou

16, todos com probabilidade , temos:

É importante notar que temos a

média m da população, que é um parâmetro. Portanto, a variância populacional

associada a essa média não envolve graus de

liberdade. A dispersão da variável em torno da média m é

dada por:

No caso do exemplo:

Vamos agora analisar os possíveis

resultados do jogo. Como tanto a primeira quanto a segunda retirada podem

resultar em 4, 10 ou 16, temos 9 combinações possíveis. A Tabela 1 mostra todas

essas amostras de tamanho 2, suas médias e variâncias.

Tabela 1

Amostras de

dois números que podem ser obtidas da população constituída por números 4, 10 e

16, com as respectivas médias e variâncias

Ao observar a Tabela 1, notamos dois fatos

importantes:

1.

A média das

médias de todas as amostras possíveis

é igual à média da população.

2. A média das variâncias de todas as amostras possíveis é igual à variância

da população, desde que as variâncias das amostras tenham sido calculadas

com o divisor n−1 (isto é, com a variância amostral).

Dizemos, então, que:

🔺A média de uma amostra é uma estimativa não

tendenciosa da média populacional.

🔺A variância de uma amostra (com divisor n−1) é uma estimativa

não tendenciosa da variância populacional.

🔔 Por que "não tendenciosa"? Porque essas estimativas tendem, em média,

aos valores verdadeiros dos parâmetros da população.

No nosso exemplo, as médias das amostras têm

diferentes probabilidades:

🔸 Médias 4 e 16, cada uma ocorre 1 vez : probabilidade 1/9

🔸 Médias 7 e 13, cada uma ocorre 2 vezes: probabilidade 2/9

🔸 Média 10, ocorre 3 vezes: probabilidade 3/9

A fórmula da média das médias ponderada

pelas probabilidades é:

Substituindo os valores da

Tabela 1:

Como as médias das amostras estão distribuídas em torno da média populacional, podemos medir essa dispersão: é a variância da média dada por:

Substituindo os valores da Tabela 1:

🔔 Na prática, porém,

não temos acesso a todas as amostras possíveis — o pesquisador normalmente

dispõe de apenas uma amostra. Mesmo assim, é possível estimar a

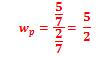

variância da média por meio da por meio da fórmula:

Onde:

· s2 é a variância da amostra (calculada com divisor n−1),

· n é o

tamanho da amostra.

Essa fórmula permite estimar a variabilidade esperada

da média da amostra, caso o estudo fosse repetido várias vezes. O desvio

padrão da média, conhecido como erro padrão da média, é então:

Portanto,

erro padrão da média é

a raiz quadrada com sinal positivo da variância da média.

Esse valor nos diz o quanto a

média obtida em uma amostra pode variar em torno da

verdadeira média populacional, sendo fundamental para construções de intervalos

de confiança e testes de hipóteses.

🟩 Conclusão

O exemplo simples que desenvolvemos, com bolas

numeradas e todas as combinações possíveis de amostras, mostra como conceitos

muitas vezes abstratos na estatística — como erro padrão da média, variância

amostral e graus de liberdade — têm uma base lógica clara e visual. Ao

calcular todas as médias e variâncias possíveis, conseguimos entender por que a

média amostral é uma boa estimativa da média da população e por que a variância

deve ser dividida por n−1n - 1n−1 para não subestimar a variabilidade real.

Mais do que decorar fórmulas, é importante

compreender a intuição por trás delas. E nada melhor do que um exemplo pequeno

e completo, acompanhado de gráficos, para transformar teoria em compreensão.